音楽家や音楽愛好者の中では よく「音の良さ」 、「良い音の基準」 の議論がなされます。

今回は、この問いに完全に答えを出す……のは難しいかもしれません。笑

しかし、いくつか考え方の補助線になりそうな情報を紹介していきたいと思います!

では、いってみよう!(๑˃̵ᴗ˂̵)و

そもそも「良い音」に絶対的な決まりは無い

「良い音」に絶対的な正解は無いはずです。

…だからこそ話のネタになるともいえます。笑

僕も、過去にこんなクイズ記事を書きました。

この類のクイズは

①「良い音」=「高級な楽器・機材の音」 という暗黙の了解

②かと言って、その違いは誰が聴いても明確に分かるものではない

要素の上で成り立っています。

(もちろん、実際に「”良い音”とされる音」が高級な楽器や機材から出ている場合は多いです。

しかし、いかなるシチュエーションでも「高級な楽器・機材の音」が「最良の音」ではありません。)

人間の認知にはバイアスがかかりまくる

バイアスとは「偏見」や「偏った見方」という意味です。

人間は色々な部分で偏った認知をしています。

イケメンや美人を見ると、性格や能力まで良く見えるハロー効果、流行しているものに更に支持が集まるバンドワゴン効果などが有名ですね。

そして、音の聴こえ方にもバイアスは存在します。

見た目や周辺情報によるバイアス

たとえば、

・値段が高い楽器・機材

・見た目がカッコいい楽器・機材

・有名なミュージシャンのサウンド

・有名なミュージシャンが絶賛していたサウンド

などは、「良い音」であると感じやすいです。

音量によるバイアス

人間は、音が大きいと「良い音」に聴こえがちです。

たとえば、ライブ演奏の音はカッコよく聴こえますよね。

もちろん、演奏や演出の良さもあるでしょう。しかし、単純な音の大きさも関係しています。

「音圧戦争※」の原因も、バイアスによるものと言えるでしょう。

※音圧戦争とは

マキシマイザーという「ダイナミクス(曲中の音量差)」を潰して「音圧(曲全体の音量感)」を上げる機材があります。

音圧を上げると派手に聴こえる(=売り上げにつながる?)ため、マキシマイザーが開発されてから様々な曲の「音圧」が上がっていきました。

もちろん、本来「ダイナミクス」は音楽的表現に必要不可欠な要素です。

ただ、一般的なリスナーには(ミュージシャンにも?)その違いが分かりづらいものです。

結果的に、巷には音圧と引き換えにダイナミクスが失われた曲が溢れました。

この流れを揶揄した言葉が「音圧戦争(ラウドネス・ウォー)」です。

しかし、近年ではYoutubeやSpotifyなどの主要な配信プラットフォームにラウドネス・ノーマライゼーション(音圧を上げすぎた音源のヴォリュームを強制的に下げるシステム)が導入されました。

↑ちなみに、YouTubeにアップロードされた音源が、どの程度ヴォリュームコントロールされているかは、再生画面を右クリックして出るメニューの「詳細統計情報」から確認できます。

この曲は元のデータの64%の音量まで自動的にヴォリュームを下げられていると分かります。

(この音源をミックスした時はラウドネスノーマライズが広まる過渡期だったので、このような音圧レベルに設定しました。しかし、今考えるとよい判断ではなかったと思います。)

したがって、現在では「いたずらに音圧を上げる意味は無くなった」と言って良いでしょう。

実際に、ラウドネス・ノーマライゼーションによって、全体的に音圧戦争は一時に比べて多少落ち着きを見せている印象です。

ただ、メジャーな音楽シーンは、未だに高い音圧レベルに設定された曲も多いのも現実です。

(単純な無知や、特に日本の場合は現在もCDビジネスが中途半端に機能していることが原因かと思われます。)

必ずしも悪くない。

…この流れだと、「そういうバイアスに騙されるな!」みたいな話になりそうです。

しかし、音楽は人間が楽しむものですから、バイアスがかかっていたとしても音楽を”楽しむ”上では全く問題は無いと思います。

…ただ、もし音楽を”する”側ならば、この辺りの知識を踏まえた上で他の判断基準も持っておいた方が良い気がします。

「良い音」の基準として使える視点

では、「良い音」を判断する基準として使える視点は何があるでしょうか。

僕が思いつくものを紹介します。

倍音の豊かさ

「倍音」とは、ある音が鳴った時に、共鳴・付随して出てくる音です。

楽器の音を含め、自然界に存在する全ての「音」は「いくつもの音が混ざり合った音」です。

※詳しくはこちら↓

この「倍音」の鳴り方で音の良し悪し判断するわけです。

同じ種類の楽器と比較して、「倍音」の鳴り方のバランスがとれている音や、「倍音」がたくさん鳴っている音が「良い音」だと評価される場合が多い気がします。

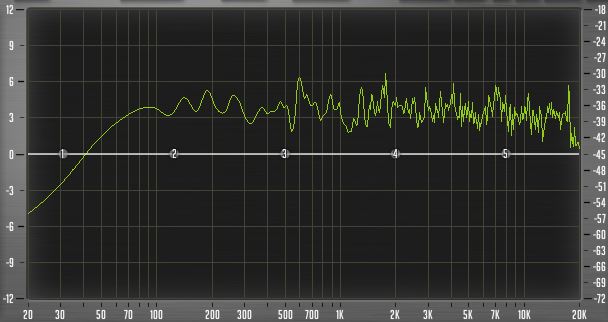

周波数帯域のバランス

人間の可聴領域は20Hz~20000Hzと言われており、音楽も基本的にこの範囲の音を使って作られています。

特に楽曲の音の良し悪しを判定する場合は、特定の領域に音が偏っているものよりバランスよく鳴っている楽曲を「良い音だ」と表現する場合が多い気がします。

もちろん、ジャンルやアレンジにもよるので、全ての音楽に当てはまるわけではないです。

しかし、僕は基本的にミックスをする時にはこの基準で音の良し悪しを判断しています。

S/N比

シグナル・トゥ・ノイズ比とは、「Signal(信号)と Noise(雑音)の比」です。

静かな音楽のヴォリュームを上げると、たまに「サーーーーーー」とノイズが聴こえませんか?

基本的にあの音は、本来音楽に必要ではない音(ノイズ)ですよね。

つまり、できるだけノイズ成分が低い方が「良い音」だと考えられそうです。

ダイナミクス

先ほどの音圧戦争の話題でも触れたダイナミクスも「音の良さ」に関与する要素だと思います。

不自然にマキシマイザーで圧縮された音より、曲中の”小さい音”と”大きい音”の音量差が自然に聴こえる音源の方が「良い音」だと言えるでしょう。

たとえば、オーケストラの演奏で「フルートが1人が弾いているセクション」の音量と、「オーケストラ全体が弾いているセクション」の音量が同じだったら音楽表現としておかしいですよね。

しっかりとした音量差(ダイナミクス)によって、演奏にメリハリがつきます。

ただ、一部「ロック系やラウド系の音楽は、そもそも『ギターを歪ませる』などダイナミクスを狭めて迫力を出す方向から進化してきているから、最終的なダイナミクスも狭い方が迫力が出る」と考える人もいるようです。

しかし、僕はあらゆる配信プラットフォームでラウドネス・ノーマライゼーションが適応される現在では、「ロック系やラウド系の音楽でも、十分なダイナミクスを確保するミックス・マスタリングをするべき」だと感じます。

なぜなら、それぞれの楽器パートへの「音作りとしてのコンプレッション」と、「音源全体のダイナミクスを音像もろとも潰す」のは全く意味合いが異なり、それは音楽的に有意義な表現だとは思えないからです。

こちらの動画も参考になるかと思います。

トレンドとの整合性

サウンド・アレンジにも時代のトレンド(流行り)があります。

たとえば、80年代ポップスはドラムに結構深めのリバーブをかけている曲が多いです。

しかし、最近のヒットチャートにそういう曲はあまり見かけません。

反対に、ここ近年は808ベース、サブベースなどを使った重心の低い曲が多く、昔では考えられない低域の音が出てます。

したがって昔、「良い音」とされていたサウンドも、現代のトレンドからするとダサいと思われる場合もあります。(逆も然りです。)

音質(ビットレート)

普段、わたしたちが耳にする音楽は「データになった音楽」です。

具体的には、A/Dコンバータという機材で、音声信号の瞬間ごとの電圧値をサンプリング(標本化)し、音声信号を数字の列に変換したものになります。

【プチ用語解説】 ・サンプリング… アナログ信号を一定の間隔で測定、デジタル信号として収集すること ・サンプルレート… 1秒ごとに信号をサンプリング(標本化)する回数 ・ビットデプス… サンプリングした標本1つあたりの情報量 ・ビットレート… 単位時間当たりに記録される情報の量(サンプルレート×ビットデプス×チャンネル数)

…専門用語が多いですけど

音質の良さは、「ビットレート」によって判断されます。

たとえば、CD音源のフォーマット「16bit/44.1kHz」のビットレートを求めるには

サンプルレート×ビットデプス×チャンネル数

の計算すればOKです。

ステレオ音源のチャンネル数は2なので

44.1×16×2= 1411.2

したがって、CD音源のビットレートは1411kbit/sとなります。

これに対して、mp3などの圧縮音源はビットレートが低いので音質が悪く、ハイレゾ音源はビットレートが高いので音質が良い… といった具合です。

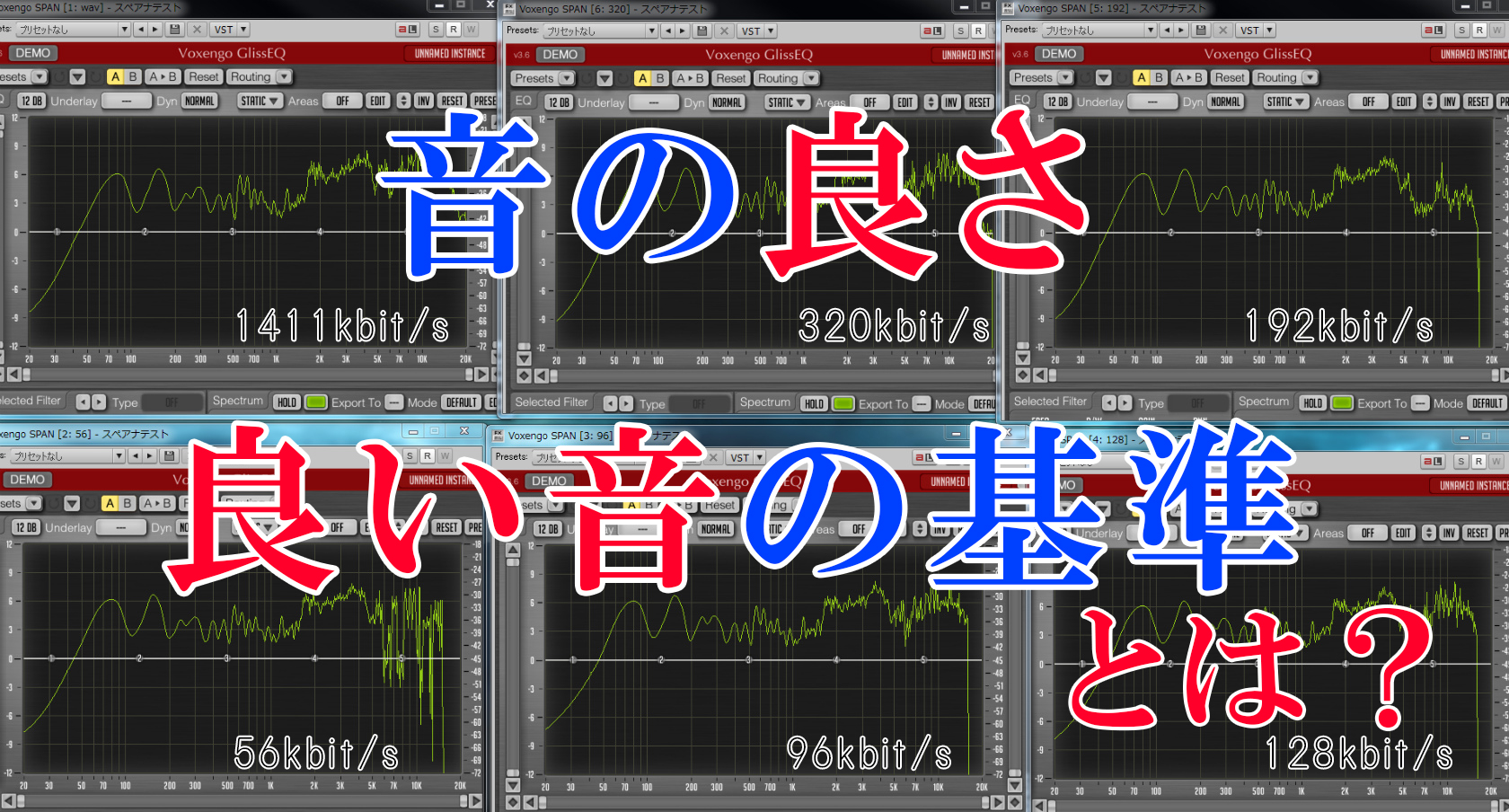

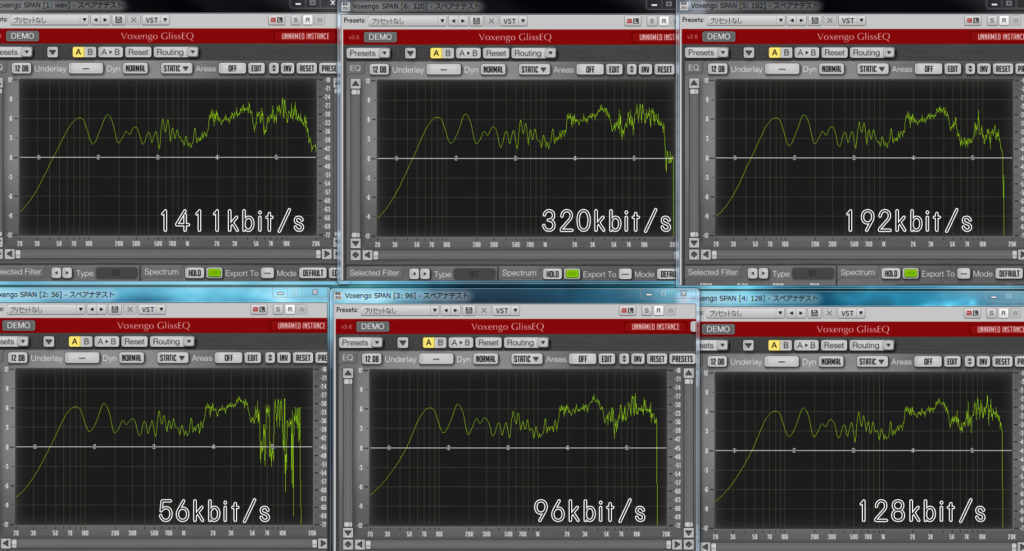

スペクトラムアナライザーで比較

この画像は、実際にビットレートの異なる同じ曲の波形を同じタイミングで切り取ったものです。

圧縮音源は、データ量を上手く減らすために、比較的音楽的に影響が少ない超高域のデータを中心に削る仕組みとなっています。

波形を見ると、ビットレートが下がるごとに高音域(波形の右端の方)が滝のようにゴッソリ消えていくと分かりますね。

したがって、192kbit/sくらいまでの圧縮音源は高域の音(シンバルや歯擦音)に注意すれば概ね判別できます。

しかし、「1411kbit/sのwav」と「320kbit/sのmp3」を確実に聞き分ける自信は僕には無いです。笑

ハイレゾ(ハイレゾリューション)について

CD(44.1 kHz/16bit)よりも高い音質の音源をハイレゾ音源と呼びます。

音声処理的には、高解像度であればあるほど理論上は有利です。

(エイリアシングノイズ対策など)

ただ、そもそもサンプルレートが44.1kHz あれば、人間の可聴領域(20Hz~20000Hz)は全てカバーされるので、人間がどの程度ハイレゾの恩恵を実感できるかは微妙です。

一方で、探してみると「耳で聴き取れなくても、その他の要素で知覚できる場合もあるようだ」とする論文もありました。

ちなみに僕自身は、基本的に曲を作るとき48kHz/24bitの環境で作業をしています。

実は曖昧な「ハイレゾ」という言葉

実は一括りに「ハイレゾ」言っても色々なパターンがあります。

- 一貫して44.1 kHz/16bitを超える環境でレコーディング・ミキシングされたもの。

- 録音は44.1 kHz/16bit以下、ミキシングは44.1 kHz/16bitを超える環境で行われたもの。

- 44.1 kHz/16bit以下で完成した音源を44.1 kHz/16bitを超えるビットレートに変換しただけのもの。

などなど…

特に「44.1 kHz/16bit以下で完成した音源を44.1 kHz/16bit以上のビットレートに変換しただけのもの」は、実質的にCDと同等なので、偽レゾと呼ばれたりします。

しかし、中には「44.1 kHz/16bit以下で完成した音源を復元技術によって音質向上させた」との謳い文句で販売されている音源もあります。

明確に聴こえている音でさえ、「音の良さ・音の違い」はよく分からないものです。

個人的には、「人間の可聴領域を超える部分に踏み込めば、さらにその違いはよく分からなくなるのではないか?」と思ってしまいます。

しかし、ここら辺のトピックも、わりとセンシティブな内容なので最終的な判断は各自にお任せします。笑

まとめ

いくつか紹介してきましたが、いかがだったでしょうか。

重ねて言いますが、最終的な判断は自分の感覚次第な部分があります。

ただ、その判断を補強するために使えそうなものがあったら使ってみてください!

では!\(^o^)/